“标准”医疗实践的未来可能比预期的要早得多,因为病人可以在看医生之前先看一台计算机。随着人工智能(AI)的发展,似乎在误诊和治疗疾病症状的日子里,而不是其根源移到我们身后。考虑一下您拥有多少年的血压测量结果,或者需要删除多少存储空间以适合笔记本电脑上器官的完整3D图像?通过常规测试和医学成像在诊所中生成并存储在电子病历中的累积数据允许人工智能和高性能数据驱动医学的更多应用。这些应用已经改变,并且将继续改变医生和研究人员解决临床问题的方式。

但是,尽管某些算法可以在各种任务上与临床医生竞争,有时甚至胜过临床医生,但它们尚未完全集成到日常医疗实践中。为什么?因为即使这些算法可以有意义地影响医学并增强医学干预的力量,但仍有许多监管问题需要首先解决。

是什么使算法智能化?

人工智能算法还必须学习如何通过多年的医学教育,做作业和实践考试,获得成绩以及从错误中学习来教育医生,与此类似,人工智能算法也必须学习如何做自己的工作。通常,AI算法可以完成需要人类智能才能完成的任务,例如模式和语音识别,图像分析和决策。但是,例如,人类需要明确地告诉计算机他们在给算法的图像中将寻找什么。简而言之,人工智能算法非常适合于自动化繁重的任务,有时在训练有素的任务上可以胜过人类。

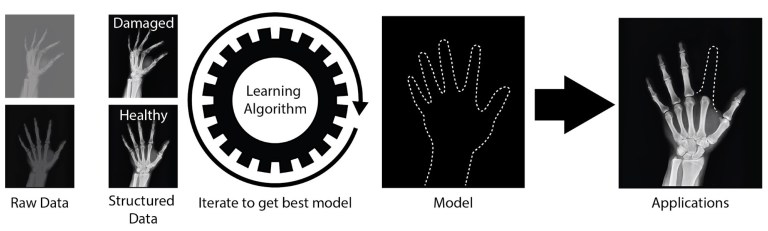

为了生成有效的AI算法,首先向计算机系统馈送通常经过结构化的数据,这意味着每个数据点都具有该算法可识别的标签或注释(图1)。将算法暴露给足够多的数据点及其标签之后,将对性能进行分析以确保准确性,就像对学生进行考试一样。这些算法“考试”通常涉及程序员已经知道答案的测试数据的输入,从而使他们能够评估算法确定正确答案的能力。根据测试结果,可以修改算法,提供更多数据或推出该算法,以帮助为编写该算法的人做出决策。

图1: AI算法 上图显示了一个算法示例,该算法可学习手的基本解剖结构并可以重新创建丢失手指的位置。输入是各种手部X射线,输出是手部缺失部位的踪迹。在这种情况下,模型是可以生成的手形轮廓并将其应用于其他图像。这可以使医生看到适当的位置来重建肢体或放置假肢。

有许多不同的算法可以从数据中学习。AI在医学中的大多数应用都读取某种类型的数据作为输入,这些数据可以是数字数据(例如心率或血压),也可以是基于图像的数据(例如MRI扫描或活检组织样本的图像)。然后,算法从数据中学习并得出概率或分类。例如,可行的结果可能是在给定心率和血压数据的情况下出现动脉血块的可能性,或者是将成像的组织样本标记为癌性或非癌性的可能性。在医疗应用中,将算法在诊断任务上的性能与医师的性能进行比较,以确定其在临床上的能力和价值。

人工智能在医学中的最新应用

计算能力的进步与医疗保健系统中生成的大量数据相结合,使许多临床问题对于AI应用而言已经成熟。以下是精确的和临床相关算法的两个最新应用,这些算法通过使诊断更加简单可以使患者和医生受益。

这些算法中的第一个是在图像分类任务中优于医生的算法的多个现有示例之一。2018年秋天,首尔国立大学医院和医学院的研究人员开发了一种称为DLAD(基于深度学习的自动检测)的AI算法,以分析胸部X光片并检测异常细胞生长,例如潜在的癌症(图2)。将该算法的性能与同一图像上多个医师的检测能力进行了比较,其性能优于18位医生中的17位。

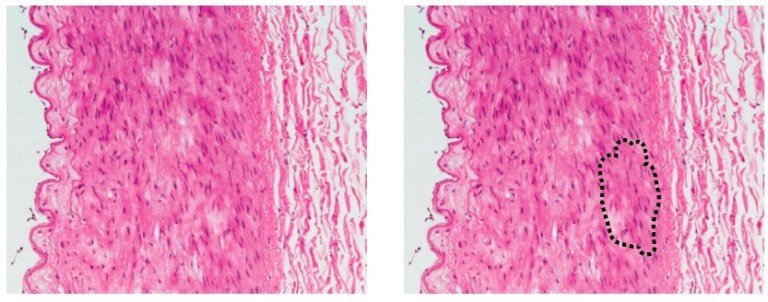

图2:人工智能算法在医学中的应用。左面板显示了输入到算法中的图像。右侧面板显示了由算法识别的潜在危险细胞区域,医生应仔细观察。

这些算法中的第二个算法也是来自Google AI Healthcare的研究人员,也是在2018年秋天,他们创建了学习算法LYNA(淋巴结助手),该算法分析了组织学切片染色的组织样本)以从淋巴结中识别出转移性乳腺癌肿瘤活检。这不是AI尝试进行组织学分析的第一个应用程序,但有趣的是,该算法可以在给定的活检样本中识别人眼无法区分的可疑区域。LYNA在两个数据集上进行了测试,结果显示正确地将样品正确分类为癌性或非癌性99%的时间。此外,当让医生与他们对染色组织样本的典型分析结合使用时,LYNA将平均载玻片复查时间减半。

最近,其他基于成像的算法显示出提高医师准确性的类似能力。在短期内,医生可以使用这些算法来帮助他们仔细检查他们的诊断并更快地解释患者数据,而不会牺牲准确性。但是,从长远来看,政府批准的算法可以在诊所中独立运行,从而使医生可以专注于计算机无法解决的情况。LYNA和DLAD都是算法的主要示例,它们通过向医生展示应该更仔细研究的图像的显着特征来补充医师对健康和患病样品的分类。这些工作证明了算法在医学中的潜在优势,那么,什么使它们无法应用于临床呢?

法规的含义和算法的局限性

迄今为止,医学算法已经对医生和患者显示了许多潜在的好处。但是,调节这些算法是一项艰巨的任务。美国食品药品监督管理局(FDA)批准了一些辅助算法,但目前不存在通用批准准则。最重要的是,创建可在临床中使用的算法的人并不总是为患者提供治疗的医生,因此在某些情况下,计算人员可能需要了解更多有关医学的知识,而临床医生则可能需要了解特定算法的任务还是不太适合。尽管AI可以帮助诊断和完成基本的临床任务,但是很难想象要进行自动化的脑部手术,例如,有时医生一旦见到病人就必须立即改变其治疗方法。通过这种方式和其他方式,医学界人工智能的可能性目前超过了AI在患者护理方面的能力。但是,FDA明确的指南可以帮助指定对算法的要求,并可能导致临床部署算法的增加。

此外,FDA对临床试验有严格的接受标准,要求在科学方法方面具有极高的透明度。许多算法都依赖于非常复杂,难以解卷积的数学(有时称为“黑匣子”)来从输入数据获取最终结果。无法“打开黑匣子”并澄清算法的内部运作方式是否会影响FDA批准依赖AI的试验的可能性?大概。可以理解的是,研究人员,公司和企业家可能不愿将自己的专有方法公开给公众,因为他们的想法被他人采纳和强化会冒着损失金钱的风险。如果专利法从当前状态改变(如果算法是物理机器的一部分,则该算法在技术上仅具有专利权),围绕算法细节的歧义可以减轻。无论哪种方式,都必须在短期内提高透明度,以免对患者数据进行错误处理或分类不当,因此更容易确定算法在临床上是否足够准确。

除了获得FDA批准的障碍外,AI算法在获得患者信任和批准方面也可能面临困难。如果没有一个清晰的算法被批准批准用于临床的人如何工作,患者可能不愿意让它用于满足他们的医疗需求。如果被迫选择,如果算法通常胜过医师,那么患者会被人类或算法误诊吗?对于许多人来说,这是一个棘手的问题,但可能归结为对算法决策充满信心。正确的决策取决于用作输入的数据的结构,这对于正确的功能至关重要。对于误导性数据,算法可能会产生误导性结果。创建算法的个人很可能直到太晚才知道他们提供的数据具有误导性,该算法引起了医疗事故。可以通过充分告知临床医生和程序员有关在算法中正确使用数据所需的数据和方法的信息来避免此错误。通过在了解临床数据细节的临床医生和创建算法的计算人员之间建立关系,算法学习错误选择的可能性将降低。

临床医生正确理解算法的局限性以及程序员正确理解临床数据是创建可在临床上使用的算法的关键。公司可能有必要牺牲其算法功能的秘密,以便更广泛的受众可以审查这些方法并指出可能最终影响患者护理的错误源。我们似乎离在诊所独立运行的算法还差得很远,特别是考虑到缺乏明确的临床批准途径的情况。定义一种算法,使其被认为对于临床而言足够准确,同时解决算法决策中潜在的错误来源,并且对算法在何处蓬勃发展以及在何处失败保持透明,这是必要的,可以让算法的公众接受度取代某些任务中的医生。然而,为了普遍提高针对各种疾病的医疗实践的准确性和效率,这些挑战值得克服。

作者Daniel Greenfield是哈佛大学生物物理学博士学位课程的一年级研究生,本文发布在哈佛官方网站sitn.hms.harvard.edu,网站编辑并推荐《英国全科医学杂志》文章《医学人工智能:当前趋势和未来可能性》,地址在bjgp.org/content/68/668/143。

成都泰丽康健科技有限责任公司